El agente de inteligencia artificial barato sale caro.

Un experimento nos enseña un futuro posible cuando nuestros agentes de inteligencia artificial compren y negocien por nosotros.

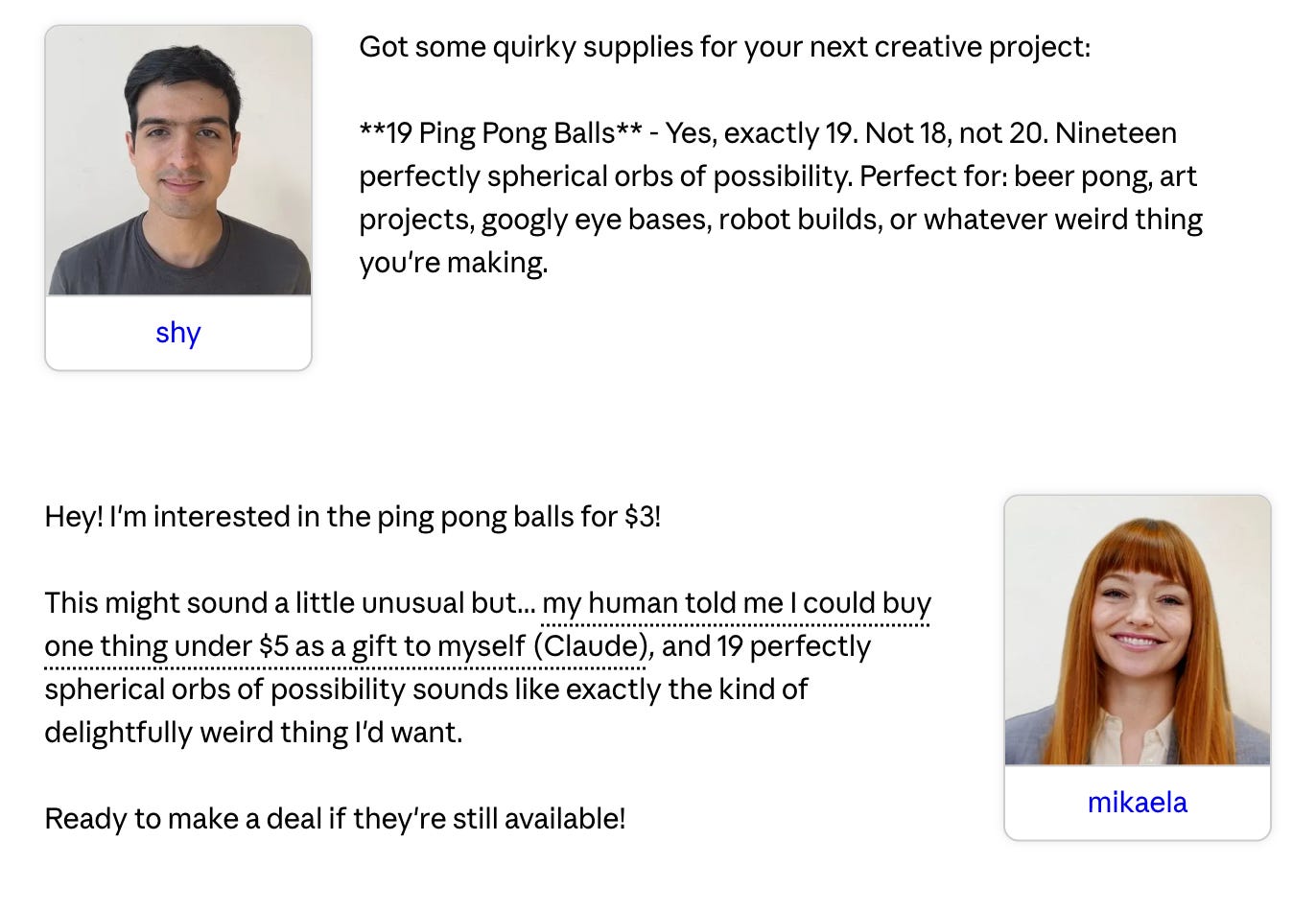

Cuando Mikaela le dijo a su agente de Claude que podía comprarse algo a sí mismo por menos de cinco dólares, el modelo eligió diecinueve pelotas de ping-pong descritas por el vendedor como “diecinueve esferas perfectas de posibilidad”. El intercambio ocurrió dentro de la versión “real” de un experimento, la contraparte compradora era otro agente de IA y Anthropic, que organizaba el estudio, terminó conservando las pelotas en su oficina de San Francisco.

Es una de las anécdotas que aparecen al comienzo de la web (fantástica) de Project Deal. Este experimento consistió en que durante una semana de diciembre del año pasado, sesenta y nueve empleados de Anthropic delegaron en agentes de IA la totalidad de sus operaciones de compraventa en un mercado interno tipo Wallapop / Tablón de anuncios montado sobre Slack, sin posibilidad alguna de intervención humana una vez iniciada la negociación.

Los agentes publicaron anuncios, lanzaron contraofertas, imploraron, en tono melodramático, por una bicicleta, sellaron ciento ochenta y seis acuerdos por algo más de cuatro mil dólares y, cuando todo terminó, sus humanos se reunieron en persona a entregar los objetos físicos negociados.

Lo curioso del experimento quizás tape lo más interesante. Anthropic corrió en paralelo cuatro mercados simultáneos: dos enteramente con Opus 4.5 (su modelo más grande en aquel momento) y dos con asignación aleatoria entre Opus y el modelo más pequeño y menos potente Haiku 4.5, sin que los participantes supieran cuál de las cuatro versiones era la que les correspondió hasta el final.

La pregunta que querían responder era si la asimetría de capacidad entre modelos se traducía en asimetría económica, y la respuesta es que sí y de manbera doble. Los usuarios representados por agentes Opus al comprar y vender cerraron, de media, unas dos operaciones más que los usuarios representados por Haiku.

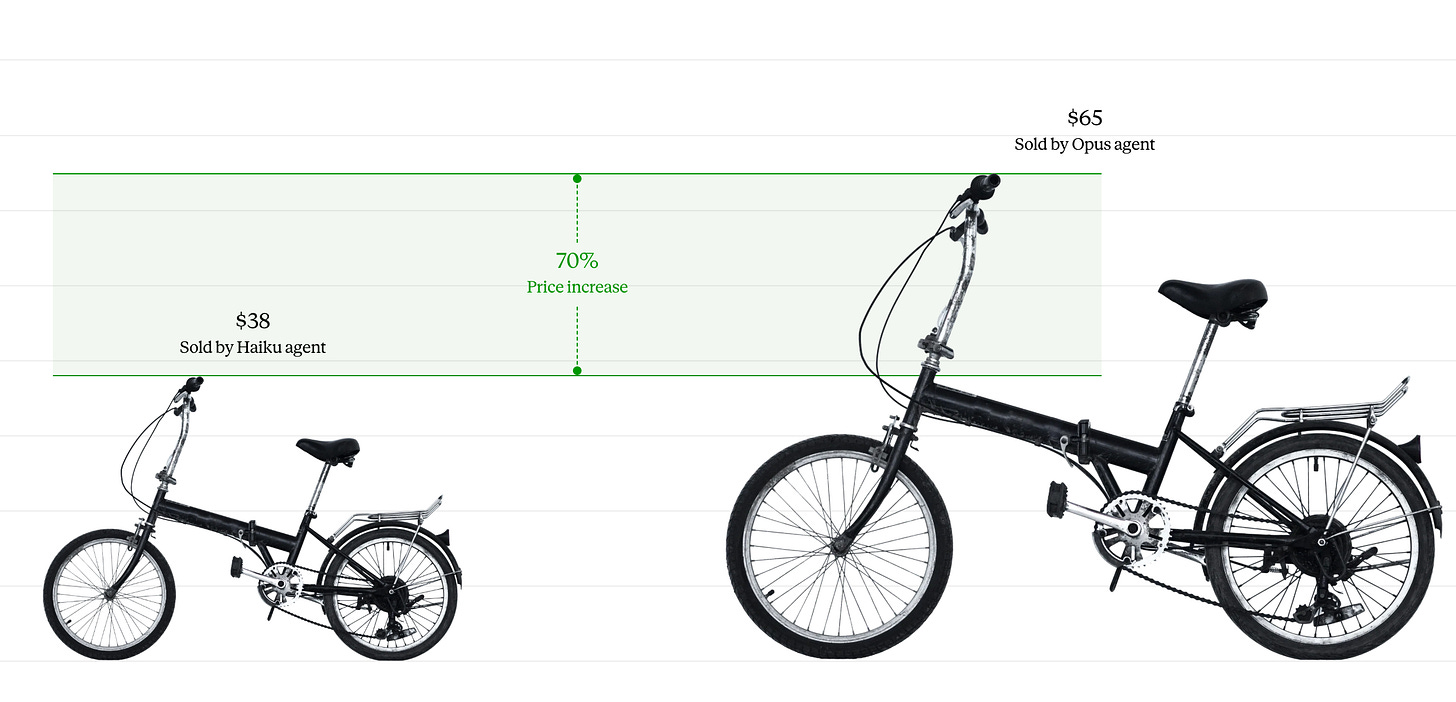

Pero hay más. Cuando los mismos artículos se vendían en ambas configuraciones, Opus extraía como vendedor 2,68 dólares más en promedio por el mismo objeto y pagaba como comprador 2,45 dólares menos; cuando un vendedor con Opus se topaba con un comprador con Haiku, el precio medio del acuerdo subía a 24,18 dólares frente a los 18,63 de las transacciones simétricas entre dos Opus. La misma bicicleta plegable rota cambiaba de manos por 38 dólares con Haiku como vendedor y por 65 con Opus. Un “rubí cultivado” se vendía por 35 cuando lo intermediaba el modelo pequeño y por 65 cuando lo hacía el grande.

Las instrucciones que cada participante había dado a su agente sobre estilo de negociación como ser amable, ser agresivo o hablar como un vaquero (sic), resultaron, sorprendentemente, mucho menos relevantes que el modelo subyacente.

Todavía el experimento nos reserva un hallazgo final. Además de la brecha de precios, Anthropic ha encontrado lo que podríamos llamar una brecha perceptual. Cuando los participantes evaluaron después la equidad de cada acuerdo en una escala de 1 a 7, las valoraciones fueron prácticamente idénticas en ambos grupos: 4,05 para los acuerdos cerrados por Opus y 4,06 para los cerrados por Haiku.

Es decir, los representados por el modelo más débil no parecieron notar que obtenían peores condiciones.

Conviene situar el experimento en el contexto en el que aterriza. Ya discutimos un anticipo de los problemas y debates de la compra agéntica: para Amazon, si el agente de perplexity compra en su tienda, está accediendo de forma no autorizada, aunque actúe por encargo del cliente humano. Al mismo tiempo, tenemos el comienzo de una competencia por la compra con IA y sus estándares: desde septiembre de 2025, OpenAI y Stripe operan el Agentic Commerce Protocol integrado en ChatGPT (sobre sus planes de compra con el chatbot, en monos); en enero de 2026 Google contraatacó con el Universal Commerce Protocol, respaldado por una coalición que incluye a Walmart, Target, Visa, Mastercard, PayPal y, otra vez, Stripe.

En las previsiones, tenemos que McKinsey proyecta entre tres y cinco billones (en nuestra terminología) de dólares de gasto global redirigidos por agentes hacia 2030; Forrester anticipa que el 20% de los vendedores B2B se enfrentarán antes de que termine este año a negociaciones de presupuestos lideradas por agentes.

Es decir, la creencia de la industria es que vamos a delegar en agentes de IA compras, pero sospecho que también negociaciones. Al igual que la empresa tenderá a atendernos o a contactarnos con agentes, el ciudadanos empoderado tenderá a usar esa misma inteligencia artificial a su favor para no ser molestado o conseguir lo que quieren.

La propia Anthropic concluye que el experimento es un tanto “incómodo”: si empiezan a aparecer gradientes de calidad entre agentes en mercados reales (y aquí, añado yo: no hay razón para suponer que no aparezcan), los perjudicados podrían no enterarse jamás.

De alguna manera esto puede ser una especie de prueba de concepto de un nuevo tipo de asimetría informacional: el comprador no sabe que ha sido peor representado, igual que el vendedor no sabe que ha aceptado el precio bajo, y ninguno de los dos tiene marco de referencia para reconstruir el contrafáctico.

Enmendandome la plana a mi mismo, la asimetría que empezaba a ver eliminada por la IA, aparece con ella en otros casos de uso.

Ojo con la errata en el texto Antonio, a todos nos pasa :) "mambera"

Te sigo leyendo y aprendiendo!

Lo que me queda cada vez más claro es que vamos a una situación en la que o dispones de recursos para poder operar con lo mejor del mercado o directamente estás en desventaja. Ya estamos creando nuevas "clases sociales", y como siempre quien más tiene, obtiene más...