La naturaleza precaria de la ventaja comparativa humana frente al agente de inteligencia artificial

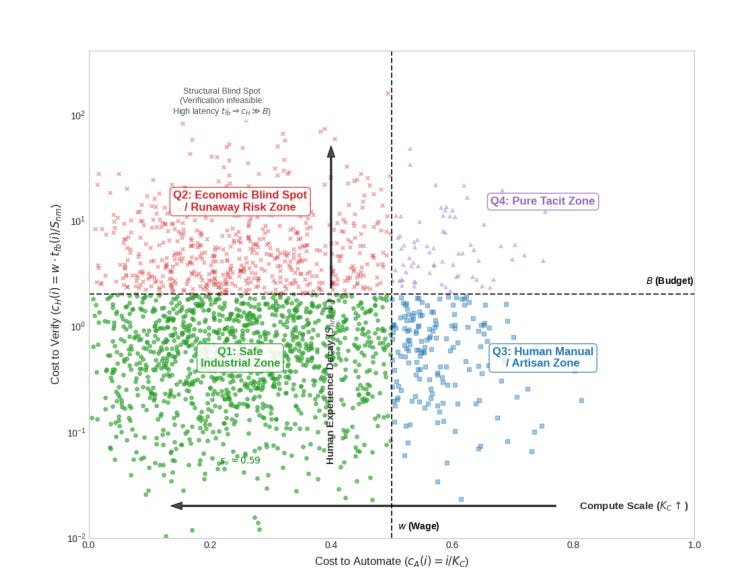

Con IA, lo automatizable será lo medible y eso nos coloca entre la Zona Artesanal Humana y la Zona Industrial Segura

Hoy volvemos sobre una reciente obsesión: cómo podemos intentar anticipar los efectos económicos y laborales del despliegue de esta nueva generación de inteligencia artificial. Llevo tiempo echando de menos un marco siquiera desde el que discutirlo.

Este paper, muy bien argumentado en el hilo de uno de sus autores, ha venido a mi rescate. Sus autores, economistas, esquivan pronunciarse sobre "¿cuándo llegará la AGI?" y plantean el dilema que ya estamos atacando: conforme vamos hacia agentes de IA capaces de acometer tareas completas, la restricción al crecimiento deja de ser la inteligencia y pasa a ser el ancho de banda de verificación humana.

El escenario al que vamos es que lo escaso será la capacidad de validar resultados, auditar comportamientos y asumir responsabilidad cuando la ejecución es abundante.

Anticipan, por tanto, que el coste de automatizar tenderá a caer pero comprobar que el resultado es correcto será caro. Ese segundo coste no escala igual, porque depende del tiempo de expertos escasos, y sobre todo de algo que los autores llaman "latencia de feedback": el tiempo que tarda la realidad en confirmar si algo salió bien. Un error de compilación se detecta en milisegundos; una mala decisión de inversión tarda años en revelarse. Cuanto más larga esa latencia, más caro verificar. La diferencia entre ambos costes define qué porción de la ejecución agéntica genera valor económico real y qué en realidad no se verá tan afectado aunque tuviéramos la AGI.

El paper establece una tipología de cuatro zonas económicas que particiona toda la actividad productiva: la Zona Industrial Segura (barata de automatizar y verificable), la Zona de Riesgo Descontrolado (barata de automatizar pero inverificable), la Zona Artesanal Humana (difícil de automatizar pero verificable) y la Zona Puramente Tácita (ni automatizable ni verificable).

Creo que la cuestión más interesante a discutir es qué pasa cuando automatizar una tarea es barato pero comprobar que el resultado es correcto sale caro, pero creo que merece la pena detenernos un poco en los cuadrantes que plantean los autores.

La Zona Industrial Segura es donde ambas condiciones se cumplen: automatizar es rentable y verificar es asequible. Aquí es donde vive la mayor parte de la adopción exitosa de IA hoy. Los ejemplos obvios son las tareas donde el feedback es casi instantáneo: generar código que compila y hace lo que esperamos o no, traducir textos que un hablante nativo revisa en segundos, generar imágenes donde el humano ve inmediatamente si el resultado es lo que pidió. Apuntaría que los autores contemplan algunos aspectos relevantes a largo plazo, como por ejemplo que queremos que el código sea seguro y fácil de mantener. Aunque eso es tema para otra discusión desde el punto de vista técnico, debemos asumir que la industria del software no queda por entero en la verificación barata.

La clave en esta zona es que la latencia de feedback es baja, ya que el error se detecta rápido y barato. Estaríamos ante la porción de la economía agéntica en la que realmente se produce valor con toda claridad.

La Zona Artesanal Humana es el cuadrante donde automatizar sigue siendo caro pero verificar es factible. Son tareas donde la máquina todavía no ejecuta mejor que el humano, pero si lo hiciera, sabríamos evaluar el resultado. El paper la trata como una zona en retroceso: a medida que el cómputo escala y la inteligencia artificial mejora, tareas que hoy están aquí migran hacia la Zona Industrial Segura. Un ejemplo sería la fontanería o la cirugía: por ahora, la ejecución física resiste la automatización, pero el resultado es verificable (la tubería pierde o no pierde; el paciente se recupera o no). El día que la robótica automatice la ejecución, si la verificación sigue siendo barata, la tarea pasa limpiamente a la Zona Segura.

La Zona Puramente Tácita (perdón por mi traducción literal) es donde ni automatizar ni verificar es viable. El paper menciona aquí lo que queda más allá del “mapa” como decisiones existenciales, ciertas formas de coordinación social, o dominios donde el propio concepto de “resultado correcto” es indeterminado. No explicitan ejemplos, pero pienso en liderazgo político, orientación espiritual, crianza, expresión artística radical. Es una zona que también susceptible de contraerse, según los autores, a medida que los modelos de mundo aprenden a simular contrafactuales y a generar hipótesis sobre entornos nuevos, pero que por definición siempre tendrá un residuo irreducible.

La contaminación en los tiempos de IA agéntica es el riesgo para la sociedad

La zona que a Catalini, Hui y Wu, autores del paper, les preocupa de verdad es la Zona de Riesgo Descontrolado. Aquí automatizar es barato pero verificar es prohibitivamente caro. ¿Por qué ocurre eso? Por dos razones que explican separadamente.

La primera es el punto ciego económico: la verificación es técnicamente posible pero sale más cara de lo que vale. Un ejemplo concreto sería auditar exhaustivamente cada línea de una base de código enorme generada por IA. Podrías hacerlo, pero el coste en horas-experto supera el beneficio esperado de encontrar el error.

Es un tema especialmente interesante porque apuntan a que la contaminación industrial clásica (la fábrica gana dinero produciendo y el coste del humo lo respiran los ciudadanos) de esta generación va a ser el riesgo. Un sistema software con una vulnerabilidad latente, o un informe financiero generado por IA con un error sutil en los supuestos, pueden parecer perfectamente válidos hasta que explotan. Por eso lo llaman caballo de troya: el riesgo viene disfrazado de producto funcional. Y el problema escala: si una empresa lo hace es un riesgo acotado, pero cuando el incentivo es el mismo para todas las empresas (porque verificar siempre es más caro que no verificar en la Zona de Riesgo Descontrolado), el riesgo no verificado se acumula en toda la economía simultáneamente.

La segunda razón es el punto ciego estructural: la verificación es imposible a cualquier precio, porque la latencia de feedback es demasiado larga o la complejidad supera los límites biológicos y tecnológicos actuales. Aquí no es que salga caro comprobar: es que no se puede.

Los ejemplos: Un producto financiero agéntico que genera retornos consistentes y de baja volatilidad pero que tiene un enorme riesgo de cola (que ocurra algo que es muy improbable pero muy dañino) invisible es el ejemplo que usan en el paper; un sistema educativo con IA que maximiza las métricas de engagement, satisfacción del estudiante y resultados en los tests pero que no forma adecuadamente el criterio. Es decir, que optimiza la métrica mientras no ayuda a construir la capacidad real.

Problemas para los junior, problemas para los sénior

Aquí se acumulan los problemas para la Zona de Riesgo Descontrolado.

El primero, el Bucle del Junior Perdido: al automatizar las tareas de entrada que hacían los junior, las empresas destruyen el mecanismo por el que se formaban los futuros supervisores. Un abogado sénior aprendió a detectar cláusulas problemáticas porque pasó años redactando contratos de nivel bajo; si esa fase la hace la IA, el próximo abogado sénior no existirá.

Segundo problema, la Maldición del Codificador: los expertos que sí existen, al supervisar y corregir a los modelos, generan exactamente los datos de entrenamiento que los reemplazan. Cada alucinación corregida es una etiqueta de alta calidad para el siguiente fine-tuning. Es un dilema del prisionero: colectivamente los expertos se beneficiarían de no codificar su intuición, pero individualmente cada uno tiene incentivos para monetizarla antes de que lo haga otro.

Lo que hace especialmente peligrosa a la Zona de Riesgo Descontrolado (recordemos, en la que automatizar es barato pero verificar caro y/o muy difícil) es la dinámica de crecimiento. A medida que el cómputo escala, el número de tareas que son baratas de automatizar crece continuamente. Pero el coste de verificación no cae al mismo ritmo, depende de expertos escasos cuya disponibilidad disminuye por el Bucle del Junior Perdido y la Maldición del Codificador. El resultado sería que la Zona de Riesgo Descontrolado se expande estructuralmente: absorbe tareas que antes estaban en la Zona Artesanal (cuando la automatización las alcanza pero la verificación no las acompaña) y tareas que salen de la Zona Segura (cuando el experto que verificaba se jubila o se encarece muchísimo).

Con IA lo automatizable será lo medible

La predicción económica central de estos economistas es un cambio sobre cómo se distribuye el valor. Tradicionalmente lo automatizable era lo rutinario (patrón común que se repite, económicamente rentable meter la máquina si tiene frecuencia), con inteligencia artificial agéntica, lo automatizable será lo medible.

Si el modelo clásico hacía que la tecnología favoreciera a los más cualificados, ahora las rentas no irán a quien sabe más, sino a quien opera en dominios que todavía no se pueden medir o a quien asume la responsabilidad de garantizar que el output agéntico es correcto. La consecuencia práctica es que tareas de alta complejidad pero totalmente medibles (programación estándar, análisis financiero rutinario, diagnóstico médico sobre protocolos establecidos) verán sus salarios comprimirse hacia el coste marginal del cómputo, independientemente del prestigio que tuvieran. En cambio, la capacidad de verificar, asegurar y avalar resultados se convierte en el nuevo cuello de botella con precio de escasez.

El paper también entra en el ‘¿y ahora qué?’ Ofrece recomendaciones sobre la observabilidad de los agentes (evitar que haya hecho mil cosas y tener que aprobarlo todo sin más pistas que la salida final), la práctica sintética para que los juniors aprendan y diseñar los sistemas bajo el principio de degradación elegante (que el agente de IA se frene cuando detecte que está operando fuera de la zona donde la supervisión humana funciona).

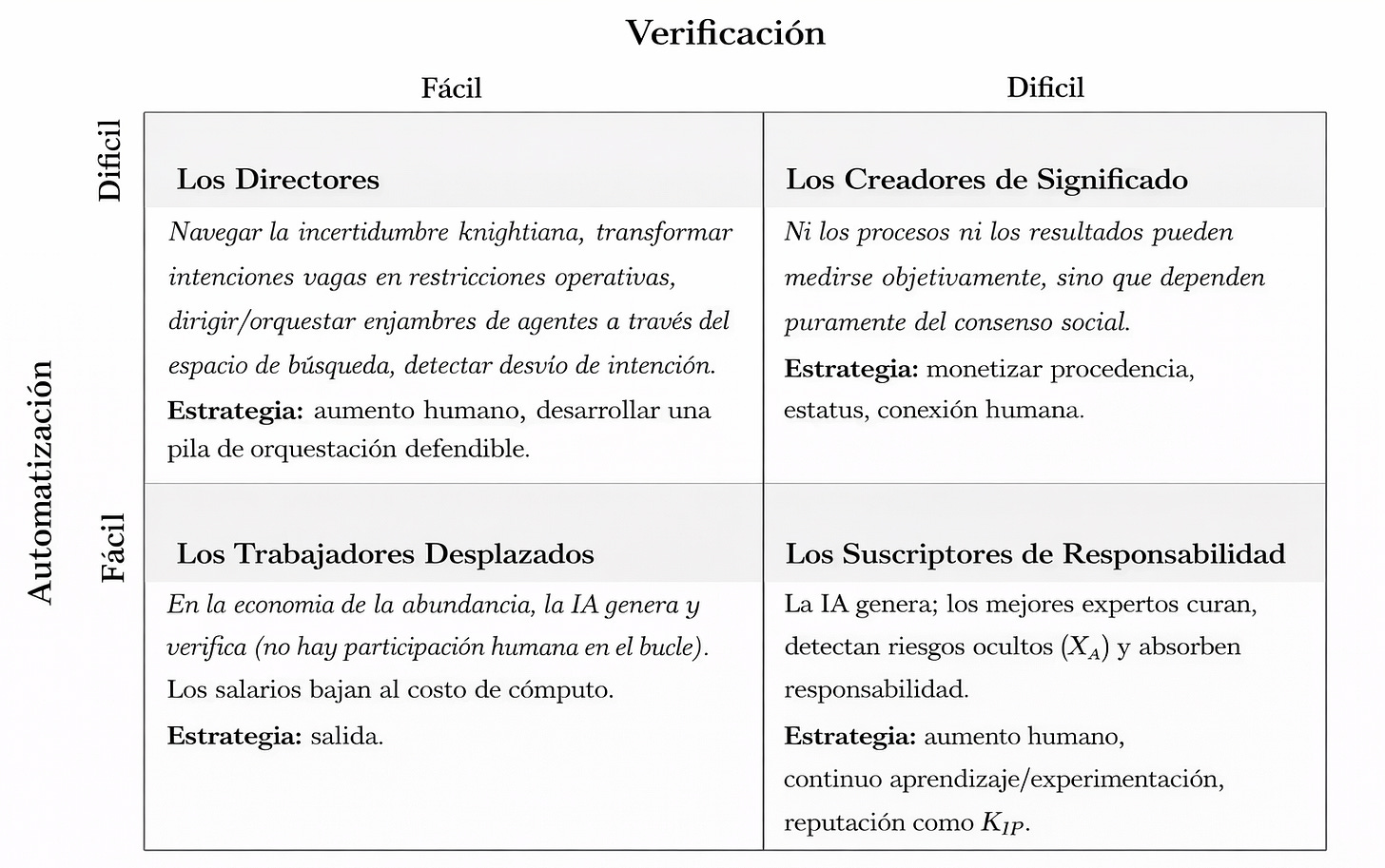

Para la carrera profesional, identifican tres posiciones donde los humanos mantenemos ventaja competitiva. La primera es director de intención: la persona que decide qué debe optimizarse, que resuelve conflictos entre valores que una función objetivo no puede capturar. La segunda es verificador y garante: el experto que comprueba que el output agéntico es correcto y firma con su responsabilidad que lo es. La tercera es creador en la economía no medible: quien opera en dominios donde el valor está anclado en estatus, conexión humana y coordinación, donde la propia definición de "resultado correcto" es indeterminada y por tanto no automatizable.

Por supuesto, no tengo claro que el paper sea correcto en todas sus supuestos ni me veo cualificado para evaluar todo su aparataje matemático. Pero sí que lo he leído y analizado con la pasión de haber dado, por fin, con un marco desde el que analizar y pensar el impacto de la IA agéntica. Además los autores me han resultado creíbles por la nota a pie de página en la que agradecen a los cuatro grandes modelos (ChatGPT, Claude, Gemini y Grok) por la ejecución, y aclaran que ellos pusieron la intención y la verificación.

Hay una idea aquí que me parece especialmente potente, que el cuello de botella deja de ser la ejecución y pasa a ser la verificación.

En biología pasa algo parecido. El cuerpo puede generar millones de células nuevas cada segundo pero lo crítico no es producirlas es asegurarse de que son correctas. Por eso existen sistemas como la apoptosis o la vigilancia inmunitaria que eliminan lo que parece válido pero no lo es. Cuando ese sistema falla, el problema no es la producción es el error no detectado.

Con la IA puede estar ocurriendo algo muy similar, producir va a ser barato pero detectar lo que está mal sobre todo cuando el error es sutil o tarda en aparecer se convierte en lo realmente escaso y valioso y eso cambia bastante la situación, porque ya no gana el que más hace sino el que mejor distingue.

Un abrazo de león 🦁

Eres como el programa de Crims, pones luz en la oscuridad :)