Poder político y Big Tech

Con inteligencia artificial tenemos a la gran tecnológica entre el ciberpunk de posicionarse por encima del Estado y la resistencia a un Leviatán tecnificado omnipotente.

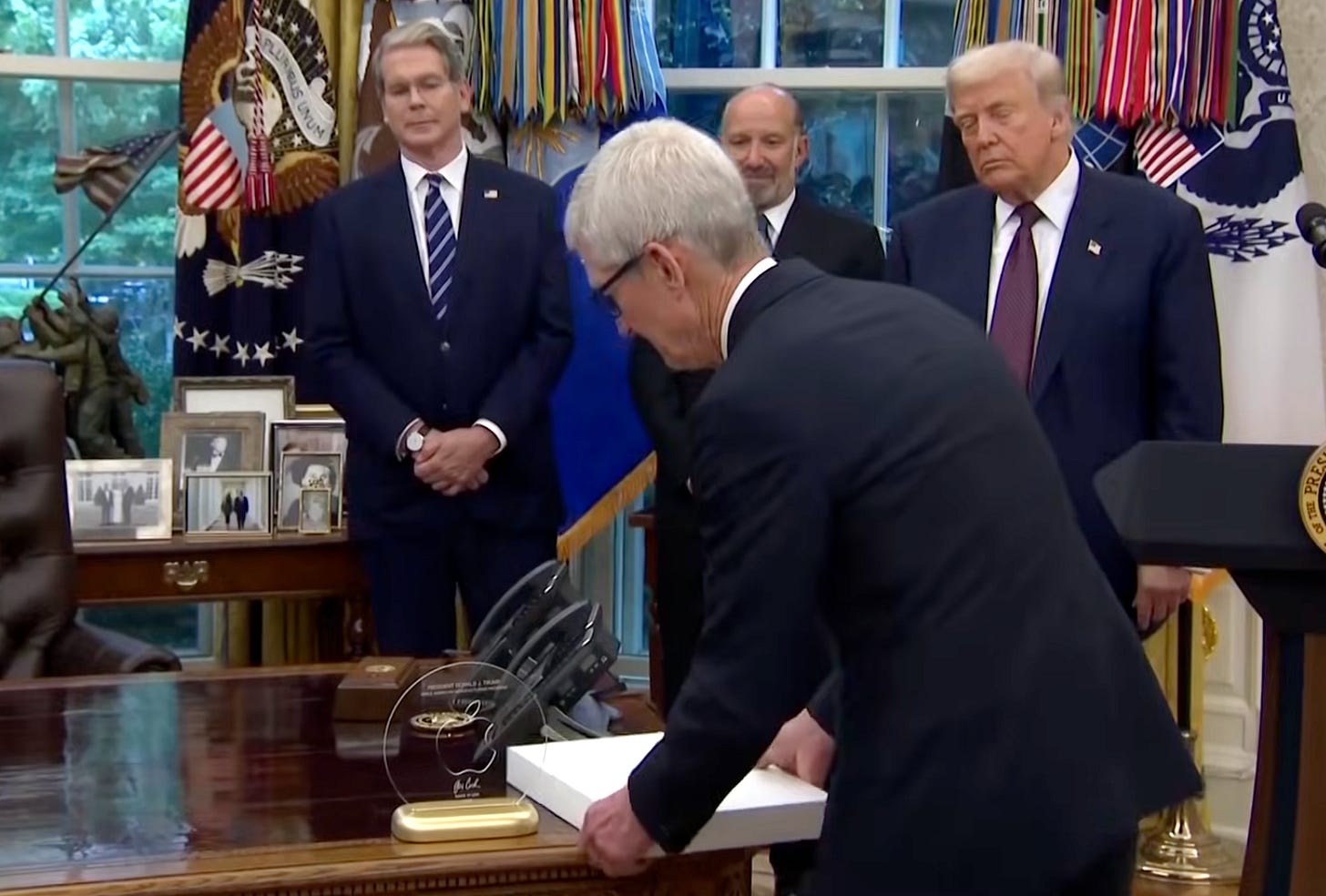

Cuando Tim Cook regaló a Trump una placa con una base de oro de 24 quilates, habían pasado más de cuatro años desde que el presidente acabara su primer mandato.

Fue en aquel fin de primer ciclo, enero de 2021, cuando ocurrió el “asalto al Capitolio”. Donald Trump estaba siendo purgado de plataformas como Twitter y Facebook, y Apple se apresuró a eliminar la app Parler - una alternativa que empujaba la base MAGA - por la escasa moderación de los contenidos tras reclamaciones de medios y políticos como Ocasio-Cortez.

Me he acordado de este arco a la hora de discutir la disputa entre la administración estadounidense y Anthropic porque, al fin y al cabo, es la del poder político y las grandes empresas tecnológicas.

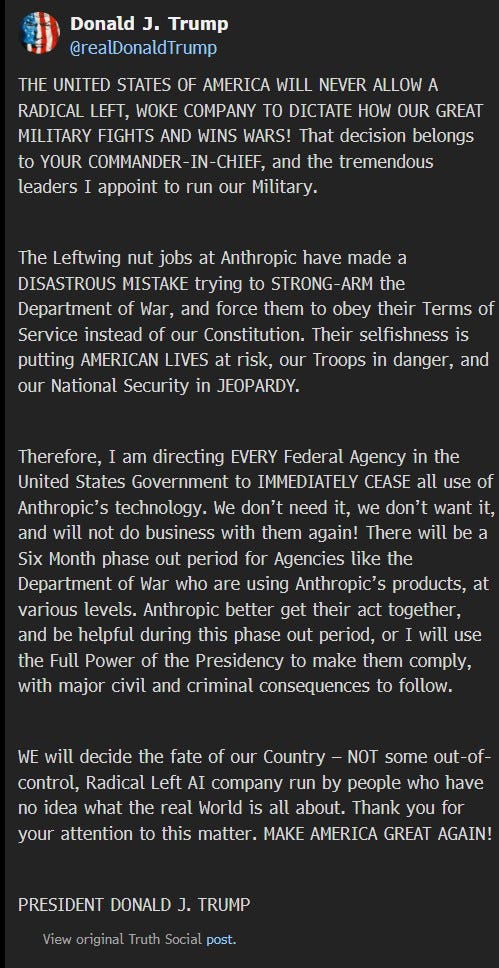

Recapitulemos. Anthropic ganó un contrato de 200 millones de dólares para integrar sus modelos Claude en operaciones de defensa que se articuló a través de Palantir. Según WSJ, llegó a tener un papel destacado en la operación en Venezuela para capturar a Nicolás Maduro. Aunque la Casa Blanca había anotado fricciones anteriormente por los límites que se encontraban, es a finales de enero cuando se endurece el tono contra la empresa de Claude. El secretario de Defensa Pete Hegseth da un ultimátum que Dario Amodei no acepta y, en el momento en que escribo esto, el Pentágono ha declarado a Anthropic un riesgo de cadena de suministro para la seguridad nacional y Trump ordenó a todas las agencias federales dejar de usar la IA de Anthropic.

¿Cuál es el núcleo de la discrepancia? Si atendemos a lo publicado por la empresa, su postura es pro uso militar de la inteligencia artificial y pro apoyar las operaciones de inteligencia y de guerra de Estados Unidos. Pero son dos los puntos clave los que han generado el conflicto:

“Apoyamos el uso de la IA para misiones legítimas de inteligencia y contrainteligencia extranjera. Sin embargo, usar estos sistemas para la vigilancia masiva nacional es incompatible con los valores democráticos.” Argumentan que una IA competente puede reunir muchos datos dispersos e individualmente inofensivos en una imagen completa de la vida de cualquier persona, de forma automática y a gran escala. Y, aunque eso podría ser legal ahora en Estados Unidos, no se corresponde con valores democráticos.

Utilización de armas autónomas. Aquí Anthropic argumenta que “pueden acabar resultando críticas para nuestra defensa nacional [..] pero hoy en día, los sistemas de IA de vanguardia simplemente no son lo suficientemente confiables para impulsar armas completamente autónomas”.

Aunque el marco del debate se simplifica en el “Trump y el Departamento de Guerra son pro vigilancia masiva y robots asesinos y Anthropic, en conciencia, se resiste a esas cosas tan malas”, lo cierto es que la postura de la empresa de Amodei es algo más ambigua.

Anoto, a modo de disclaimer, que estoy de acuerdo con los principios de Anthropic y de hecho iría más allá. Estoy en contra de la vigilancia masiva de ciudadanos (pero no sólo de la de los estadounidenses como apunta Amodei) y de las armas completamente autónomas (pero no sólo por razones técnicas).

Se añade al debate que OpenAI ha firmado un acuerdo con el Departamento de Guerra para que utilice sus modelos, contemplando según Sam Altman las mismas líneas rojas (no vigilancia masiva, no armas letales autónomas).

Resulta extraño que ambos digan que exigen lo mismo y que los resultados de las negociaciones sean los opuestos. Que Altman esté pidiendo que las condiciones de su acuerdo sean ofrecidas al resto de empresas de IA junto a una circular de apoyo a Anthropic firmada por algunos empleados de Google y de OpenAI apunta a que es consciente de que en gran parte de la opinión pública la percepción de ambas compañías es bien diferente.

Creo que este mensaje de un oficial del gobierno estadounidense aclara algo el tema. El núcleo de la discusión es quién decide que se está haciendo algo ilegal, establece y tutela los límites de la herramienta. Su explicación del desacuerdo es que Dario Amodei y Anthropic parecen tener claro que son ellos quienes interpretan estos asuntos. En el caso de OpenAI y Altman acaban de publicar detalles del contrato y, según ellos, el Departamento de Guerra usará sus modelos de IA a través de la nube, por lo que mantendrán el control de la pila de seguridad operativa y la capacidad de verificar de forma independiente que no se crucen las líneas rojas.

Es probable que el diablo esté en los detalles. A pesar del empuje comunicativo de OpenAI, creo que viene al caso la declaración a medios de una portavoz de Anthropic: “El nuevo lenguaje, presentado como un compromiso, se combinó con jerga legal que permitía ignorar esas salvaguardas a voluntad”.

En por qué han divergido entonces las negociaciones caben dos hipótesis, en mi opinión.

Por un lado Trump y su administración se revuelven contra lo que sienten que es una fuerza que se les impone a ellos y ahí poco acuerdo va a conseguir Amodei apelando a razones.

Y, por otro, porque esta situación evoca en sus detalles al escenario largamente anticipado por la literatura ciberpunk, y es el de la gran tecnológica por encima del Estado. ¿Quién debe decidir, juzgar y garantizar los derechos democráticos? En un Estado de derecho, esa competencia corresponde a los poderes públicos. Pero Anthropic se posiciona como el garante y árbitro de los valores democráticos y la ética de la defensa nacional, aunque carece de la rendición democrática de cuentas.

Hay algo peculiar en el caso de uso de la inteligencia artificial y es que la herramienta sabe lo que estás haciendo con ella y que la manera en que se enfoca la seguridad en la disciplina es la de detectar algunos usos e impedirlos.

No estamos, recordemos, ante empresas que se plantean si estar en la industria armamentística: ambas lo decidieron hace tiempo. Pero, siendo su producto el modelo de inteligencia artificial, difieren de las que aportan dispositivos, cableado, sistemas operativos u otro software adicional.

Hay otra corriente de la ciencia ficción que resuena en este debate, el de la sociedad de control articulada por un Estado que merced a la tecnología puede vigilar a todos los ciudadanos y ser preciso y omnipotente en la administración de la violencia. Llevada a la situación que tenemos sobre la mesa, es paradójico que la gran empresa tecnológica se postule como la resistencia democrática a este Leviatán hobbesiano de poder absoluto.

Si revisamos la “constitución de Claude” que diseñó Anthropic es interesante cuestionar por qué eligieron ese término. A la luz de los hechos acaecidos esta semana, podemos sospechar que aspiran a un ordenamiento diferente del jurídico actual para su inteligencia artificial.

Creo que la postura de Dario Amodei está ganando gran parte de la opinión pública porque se enfrenta a la administración Trump. El contexto actual es el despliegue de un arsenal tecnológico para las acciones del ICE - reconocimiento facial, monitorización de redes sociales y análisis masivo de datos- tanto para identificar inmigrantes indocumentados como para seguir a personas que protestan contra la agencia. Al invocar el estar en contra de las armas autónomas (realmente no lo están) y de la vigilancia masiva (tampoco, sólo se refieren a los estadounidenses), resuena a “estar a favor de lo bueno y en contra de lo malo”.

Pero caben otros enfoques del debate.

Uno es el ya mencionado de que si el ejército opere bajo la ley, el control civil y la supervisión del Congreso, entonces resulta harto discutible que la interpretación de la ley y la vigilancia de su ejecución correspondan a la big tech que provee de inteligencia artificial al Estado.

El otro es que podemos estar asistiendo a una chinificación acelerada. Que el intervencionismo de la actual administración estadounidense y su explícito sometimiento a industrias y empresas refleje una competencia con China, que tiene un mayor control discrecional sobre todos sus recursos.

Dicho de otro modo, en China el Estado no se va a encontrar con una Anthropic queriendo tutelar los límites de uso de la inteligencia artificial. Aunque las democracias occidentales puedan requisar e intervenir empresas y bienes privados en circunstancias excepcionales, el trumpismo tensiona los límites del gobierno. De hecho en este caso, si lo que analiza aquí Ball es correcto, Anthropic tiene el problema de que sus inversores deben salir del accionariado para seguir siendo proveedores del Estado. No descartemos que el fin del camino sea forzarles a vender la empresa en lo que puede ser un fenomenal tiro en el pie para Estados Unidos: eliminar de tu lado a una de las líderes en la tecnología clave de este siglo.

Apple purgó al trumpismo en su momento por la misma razón que luego le hizo regalos y acató sus directrices, por lo mismo que se amolda a las exigencias del gobierno chino o aplica la DSA europea. Porque, en última instancia, el poder político se impone. Anthropic está atrapada por sus propios logros, si creas una tecnología clave en el poder, la guerra y la economía, no puedes sustraerte a su disputa por parte del Estado.

Esto es un temazo.

Al final, no deja de ser una lucha entre las élites por una cuestión que ha generado un conflicto de intereses claro entorno a este asunto específico de uso de la IA en el campo de la Defensa y Seguridad Nacional.

Lo que no tengo claro es cuáles son los incentivos que Amodei ha identificado para enrocarse en esa postura.

Muy interesante. Gracias por compartir.

Es un debate complejo y difícil de tener una postura clara.

Como indicas en el texto, debería corresponder al poder politico, elegido en elecciones y respaldado por sus nacionales, la gestión del uso de la fuerza. Sometido al imperio de la ley y control civil ejecutivo.

Casi lo opuesto a que la decision de uso, despliegue o creación dependa de una corporación privada, sujeta a intereses propios.

El dilema se muestra cuando confluyen una empresa que aparenta interesarse mas en los riesgos de uso y violación de libertades establecidas con un Estado que pretende llevar a cabo su política por encima de las limitaciones democráticas.

Creo que inevitablemente se llegará a la cesión de estas herramientas al poder politico. Nos encontraremos con la realidad de que, en el fondo, lo que importa es la persona o grupo dirigente que tendrá el inmenso poder de llevar al uso militar esta nueva tecnología.

Y viendo el panorama actual de gobernantes politicos, no pinta muy bien para los ciudadanos, da igual desde donde lean esto.