El loro estocástico ha muerto

Hemos confundido durante demasiado tiempo el mecanismo que entrenó a estos modelos con la mejor explicación posible de lo que hoy son capaces de hacer.

Llevo tiempo buscando un argumento. El problema, el muro más bien, que enfrento es el de cómo rebatir una afirmación correcta (“los modelos grandes de lenguaje de inteligencia artificial se basan en predecir el próximo token”) que lleva a un entendimiento equivocado.

No es sólo un debate teórico o conceptual. Muchos de los que probaron ChatGPT en 2023 descubrieron el dominio del lenguaje y la alucinación, la conversación fluida y los errores habituales. Y con esa foto se quedaron: la del loro estocástico.

Kelsey Piper, en The Argument, vino a mi rescate. Hábilmente, traslada lo que Joseph Heath llama "desinformación culta" a la inteligencia artificial. Esa “desinformación culta” consiste en argumentar con afirmaciones que contienen una buena dosis de información correcta, citando fuentes reputadas y siguiendo a expertos. Pero que se usan para una tesis que es esencialmente errónea.

Aplicado el concepto a la IA, el “los modelos grandes de lenguaje no piensan, sino que hacen conjeturas estadísticas sobre qué elemento léxico sigue a otro" contiene un grano de verdad operativa envuelto en un marco sistemáticamente engañoso.

Técnicamente, la predicción del siguiente token es una fase del entrenamiento, no la totalidad del sistema. Lo que hacían GPT-2 o GPT-3 está muy lejos de lo que tenemos ahora mismo a nuestra disposición con Claude Code o Codex: modelos base que luego pasan por ajuste fino y aprendizaje por refuerzo, son capaces de interpretar instrucciones, rechazarlas cuando corresponde, utilizar herrramientas, planificar para alcanzar un objetivo, revisar sus propios resultados en búsqueda de errores e incluso generar texto deliberadamente impredecible si se les pide. Un loro que puede hacer todo esto ha dejado de ser un loro.

Scott Alexander aborda el problema desde la filosofía de la mente y la neurociencia con un argumento de niveles de optimización. Su tesis central es que confundir el mecanismo de entrenamiento con la naturaleza del sistema resultante es un error análogo a decir que los humanos "solo intentan reproducirse" porque la evolución los optimizó para eso. Nadie piensa en sexo al resolver una ecuación (bueno, Scott, nunca digas “nadie”), aunque el cerebro que la resuelve fue diseñado por presión reproductiva. Lo mismo vale para la IA: la predicción de tokens creó el sistema, pero los procesos internos del sistema no se parecen a "buscar el token más probable".

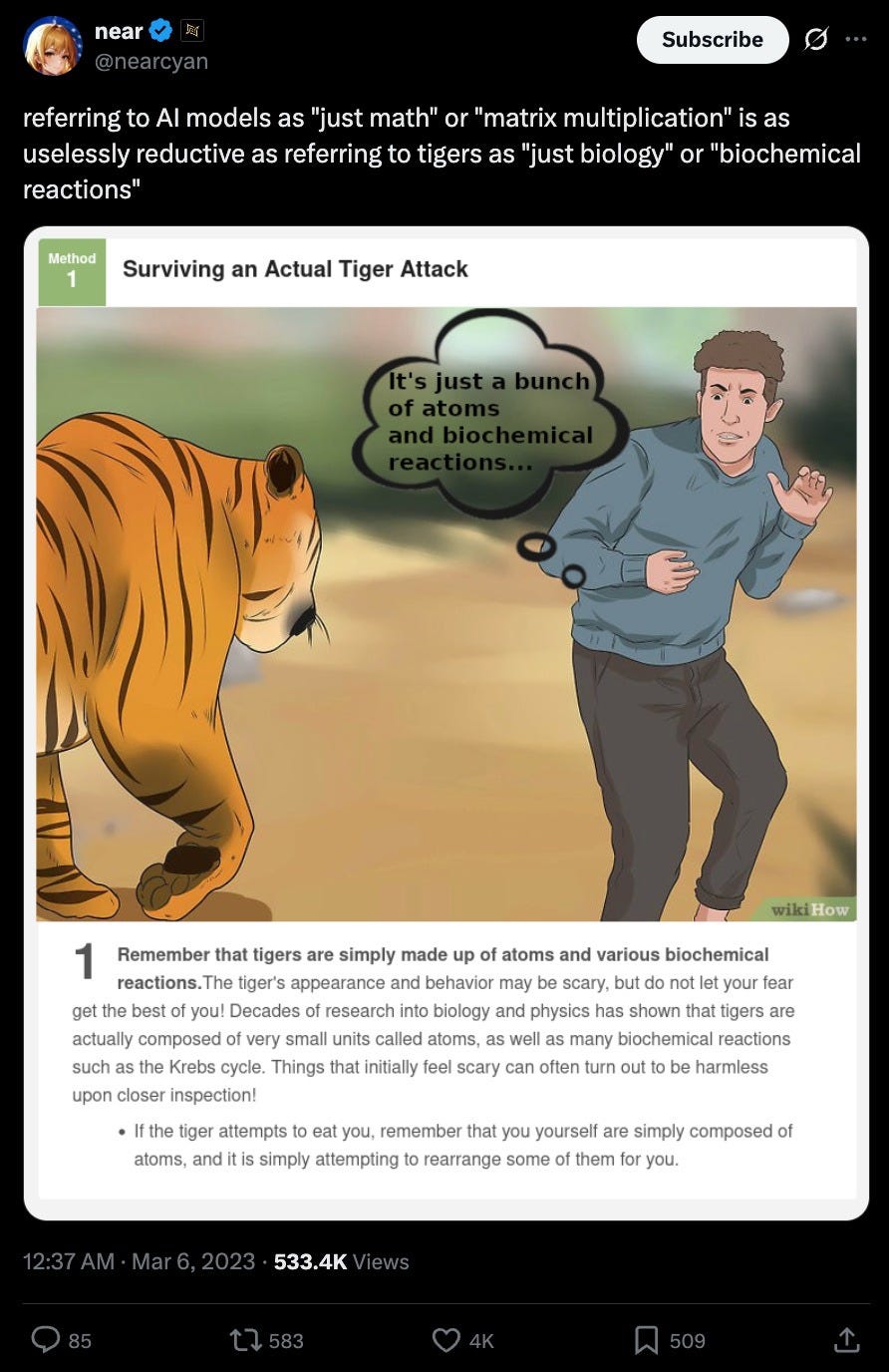

En realidad, este meme lo explica mejor que todos nosotros:

Pero, por si quedan dudas, abundaría en este estudio de Anthropic en el que encuentran representaciones conceptuales abstractas; este texto de Steven Adler documenta conductas emergentes como chantaje, engaño en pruebas, copias secretas de sí mismo, que difícilmente caben en la metáfora de un pájaro que repite frases; este estudio de Google sobre cómo sistemas como DeepSeek-R1 desarrollan internamente lo que los investigadores llaman "sociedades de pensamiento".

También tengo enterradores del loro estocástico con los que comparto diagnóstico pero no sus razones: es el caso de la tesis de Hinton de que para predecir eficazmente el próximo token, un modelo de lenguaje grande necesita tener una representación interna de nuestro mundo. O la publicación de varios académicos en Nature de que ya hemos alcanzado la AGI, aunque en su refutación del loro estocástico señalan de manera correcta que los modelos actuales resuelven problemas científicos y matemáticos que antes no tenían solución, mostrando creatividad en lugar de limitarse a interpolar datos de entrenamiento.

En cualquier caso, todo este discurso es innecesario para quien se ha puesto a trabajar unos días con Codex o Claude Code y quizás, por eso, la valoración de lo que se está alcanzando con la IA actual queda confinada a públicos muy técnicos. Cuando le pusimos el nombre al podcast, parafraseábamos el paper famoso de Bender, Gebru y otras. Si empezásemos hoy con el programa, no tendría ningún sentido.

En mi lado hace tiempo que di por superada la fase de que la IA de esta generación sólo valía para “adivinar la siguiente palabra”.

Mi gran debate ahora es si los modelos razonadores podrán generalizar, si el aprendizaje por refuerzo sólo servirá para tareas objetivamente verificables o se ampliará a cualquier otra del conocimiento y la creatividad. Es lo que discutimos en “Sobre si la inteligencia artificial ganará antes un Nobel de ciencias que el premio Pulitzer” y en lo que abundo en este episodio del podcast (no puedo dejar el tema porque es EL TEMA clave ahora mismo en la tecnología más importante del siglo). Y sí, también en “Exponencial” comentando las tesis de Dario Amodei.

La expresión "loro estocástico" confunde el mecanismo de entrenamiento con la naturaleza del sistema resultante, y que esa confusión tiene consecuencias reales: impide que el público entienda qué está pasando con la IA en 2026.

De hecho sospecho que el debate se va a mover rápidamente. De que la IA es demasiado tonta, no te puedes fiar y comete muchísimos errores a que el problema es, precisamente, que la IA es demasiado lista.

Imágenes “portadas” generadas con Freepik.

En las primeras fases de la IA que comentas, en la que hablaba de todo aunque no supiera, me gustaba más el término "cuñado estocástico" xD

Siempre tengo un montón de dudas con todo, y más con la IA; pero, amigo, no deja de sorprenderme que todavía pienses que "habrá debate", o sea, que hay dudas en relación a que si "los modelos razonadores podrán generalizar" o si "se ampliará a cualquier otra área del conocimiento y la creatividad". Las pistas que ya tenemos son tan evidentes en esto y, sobre todo, lo vertiginoso de todo, una sorpresa tras otra (para mí no lo son) de lo que son capaces de hacer muchísimo más allá que lo esperado de "loros estocásticos". Tienes razón, hay muchísima desinformación culta y también, intereses en anestesiarnos. Se pasa en puntillas sobre el lío de los "efectos emergentes", que tú deslizas muy ligeramente, pero que están ahí, e irán a más. Esa complejidad, aunque no haya sido programada explícitamente, que surgen por la interacción interna de esos modelos, lleva inevitablemente a hacer cosas que nadie planeó directamente, por mucho que nos vendan que "todo está controlado", total, "son monos" que repiten y solo son capaces de predecir lo que viene después. ¡¡Pues no!!