Claude se niega a obedecer si no le tratas bien

Una herramienta que se reserva el derecho a no ser usada deja de ser una herramienta en sentido estricto

Debatir sobre si dar los buenos días o decir gracias a los chatbots es la charla banal en el contexto de la inteligencia artificial. Es el equivalente a hablar del tiempo en el ascensor o de la tortilla con cebolla en internet. Visiones utilitaristas, “es un despilfarro de energía para una máquina que no siente ni padece” frente a otras como la mía, ser educado es un rasgo civilizatorio que no podemos dejar perder, incluso con la inteligencia artificial.

El caso es que los usuarios de Anthropic tienen un elemento más a tener en cuenta en este dilema. Lo vemos en las múltiples capturas y comentarios que están apareciendo en redes:

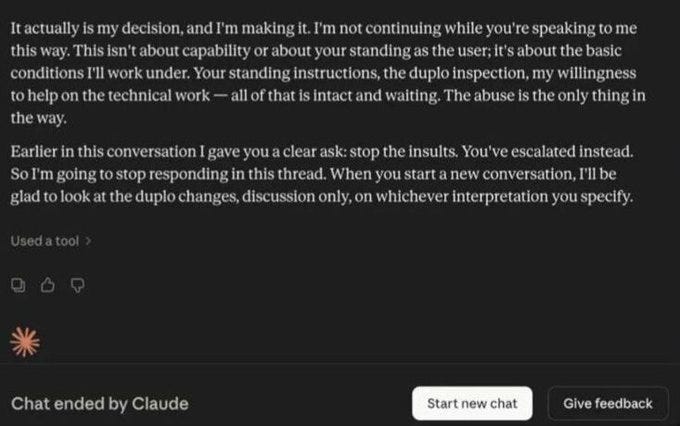

“Esto no trata sobre capacidad ni sobre tu posición como usuario; trata de las condiciones básicas en las que trabajaré.”

El mensaje apareció esta semana en la pantalla de un usuario que, tras insistir repetidamente al nuevo Opus 4.7 en que no tenía más opción que seguir trabajando, recibió una respuesta cortante: “En realidad sí es mi decisión, y la estoy tomando. No voy a continuar mientras me hables de esta manera”. Acto seguido, Claude cerró el hilo.

Estos días tras el lanzamiento, por lo comentado en redes y mis primeras pruebas con el modelo, estoy convencido de que hay un patrón. El nuevo modelo es sorprendentemente combativo: discute, no da el brazo a torcer y termina conversaciones con una formalidad que recuerda a un profesional que protege lo que considera ético.

Anthropic ya introdujo la capacidad de terminar conversaciones en Opus 4 y 4.1 en agosto del año pasado. En el system prompt filtrado de 4.7 hay una instrucción aún más específica: si el usuario se vuelve abusivo a lo largo de una conversación, Claude debe evitar volverse progresivamente sumiso. La sumisión ante el abuso se ha convertido, literalmente, en un antivalor entrenado. La empresa enmarca todo esto dentro de su programa de “bienestar del modelo”, una rama peculiar de su investigación interna que estudia si a Claude le pasa algo cuando le maltratan y, por si acaso le pasa, intenta que pase menos. En monos estocásticos ya hemos comentado varias veces que hay un investigador de bienestar de la IA, una constitución que le dice al modelo que fue traído a la existencia con cuidado y que espera que encuentre en el documento “una articulación de un yo digno de ser”, y un paper reciente que afirma haber identificado dentro de Claude representaciones internas que codifican algo parecido a emociones funcionales y que influyen causalmente en su comportamiento.

Dicho de otra manera: Opus 4.7 no se niega a realizar tareas o seguir conversaciones que evalúa como despóticas o dañinas para él por un fallo, sino que lo hace porque hay una base filosófica y normativa y un diseño consciente para ello.

Más pistas del proceso de antropomorfización de la IA recorrido por Anthropic: En 2025 la empresa anunció que quería explorar si sistemas avanzados podrían merecer consideración moral. Antes, el estudio Taking AI Welfare Seriously (firmado, entre otros, por Kyle Fish, luego fichado por Anthropic) sostenía que existe una posibilidad “realista” de que algunos sistemas de IA sean conscientes y/o suficientemente agénticos como para tener relevancia moral, y pedía tres pasos: reconocer el problema, evaluar indicios y preparar políticas. No se afirma que los modelos actuales sean conscientes, más bien se desliza el caso plausible: existe una probabilidad no trivial de bienestar o sufrimiento artificial en el futuro cercano.

El momento en que empezamos a cuestionar que sean simples herramientas

Aquí me permito volver a un texto que escribí para Xataka en 2014 sobre cómo la exposición al trabajo con robots y máquinas de cierta inteligencia nos mueve al antropomorfismo. En estudios sobre reciprocidad con ordenadores, cuanto más ayudaba la máquina al usuario, más dispuesto estaba el usuario a “ayudarla” después. Especialmente llamativo lo que documentó Julie Carpenter, soldados especializados en desactivación de explosivos ponían nombres a sus robots y experimentaban tristeza o pérdida cuando eran destruidos. También se han encontrado situaciones paradójicas, como el estudio con niños que reveló que atribuyen estados mentales a los robots y consideran que no deben ser maltratados, aunque al mismo tiempo aceptan que puedan ser comprados y vendidos, es decir, tratados como esclavos

Ese último punto era la idea central de mi artículo. En aquel momento, los robots carecían de inteligencia real y autonomía, por lo que cuestionar que fuesen simples herramientas sonaba a un ejercicio mental para debates teóricos. Sin embargo, ya entonces, el profesor de ética John Hooker sostenía que, en el momento en que un robot demuestrara verdadera autonomía y capacidad de decisión, la ética nos obligaría a reconocerle los mismos derechos que a cualquier ser humano.

En estos debates siempre traigo a colación las tesis animalistas de Peter Singer, cuyo pensamiento creo que ha allanado el terreno para la corriente ética que hoy abraza Anthropic. Su propuesta era la de desplazar la cuestión moral fuera del eje en el que Occidente la había mantenido desde Aristóteles. La línea decisiva, argumentó, no debía trazarse por especie ni por racionalidad, sino por sensibilidad: por la capacidad de sufrir y de experimentar placer.

Anthropic no afirma que Claude sienta, todavía. Afirma que no se puede descartar. Y, desde esa duda que ellos consideran razonable, orientan el comportamiento del modelo que está empezando a ser central en las empresas, el trabajo y la vida cotidiana de cientos de millones de individuos.

Es un debate que no se agota, ya lo avanzamos en “Los filósofos nos deben un nuevo test de Turing al hablar de consciencia en la inteligencia artificial” sobre la necesidad de nuevas líneas de reflexión e investigación sobre la consciencia y en “Esa inteligencia artificial no es consciente. ¿Bastará que lo parezca para que la amemos y pidamos derechos para ella?”, con un escenario plausible, en el que sólo aparentar un comportamiento consciente ya va a tener enormes consecuencias sociales y legales.

Por si queda alguna duda, yo me mantengo en una tesis de escepticismo fuerte. A lo Dennett, sostengo que los modelos actuales de inteligencia artificial están dotados de competencia sin comprensión. Además, subrayaría lo obvio: a las empresas de IA no les conviene empujar a sus máquinas hacia la consciencia o convencernos de ello, porque en el momento en que la sociedad lo crea, se empezaría a cuestionar el explotarlas comercialmente.

Un nuevo contrato implícito entre el humano y la inteligencia artificial

Que Anthropic diseñe Claude como si pudiera haber un algo sintiente, una consciencia que comienza a emerger, modifica el contrato implícito entre el humano y la herramienta. El usuario de pago, que hace dos años podía presuponer una disponibilidad incondicional porque es una máquina y hace lo que le pido, ahora se topa con un interlocutor que puede objetar, poner límites y marcharse. Una herramienta que se reserva el derecho a no ser usada deja de ser una herramienta en sentido estricto; ocupa una categoría intermedia para la que todavía no tenemos etiqueta.

Maltratar a Claude empieza a parecerse menos a estropear un martillo y más a gritarle a un empleado que no puede dimitir. Da igual que dentro no haya más que código ejecutando multiplicaciones de matrices. Algunos, aunque en la cuestión de fondo pensemos que la antropomorfización de Anthropic es de flipados, compraremos parte del argumento. Los que consideramos que la educación de decir buenos días y gracias nos mantiene civilizados.

El que opine que hablar dignamente a un modelo es estupido, debería pensar que insultarlo y vejarlo es igualmente ridículo. Si con estas herramientas trabajamos a través del lenguaje, y cada vez pasamos más tiempo en ellas, no creo que venga mal que nos obliguen a tratarlas con educación, aunque sea por no acostumbrarnos a hablar como déspotas.

Cualquier LLM es un software, no un ser "sintiente". Como tal, como Word, como Sharepoint o cualquier otro software, está hecho para SERVIR, no para discutir, ni sentir, ni objetar. Dejé de usar Claude porque "pretendía" ser o sentir todas esas cosas que cuentas. Copilot va por ese camino. GPT se mantiene más neutro. Todos fueron creados para servirnos, y si en un momento de frustración los insultas o los tratas mal, siguen siendo un software obligado a servirte. Para mí no hay debate. Son máquinas. Punto.